近日,机器人学院周易教授团队(NAIL实验室)的两项科研成果被欧洲计算机视觉大会(ECCV 2024)录用。ECCV是计算机视觉领域的三大顶级国际会议之一(2024年录用率约27.9%)。该会议每两年举办一次,今年将于9月29日至10月4日在意大利米兰召开。

碰撞时间估计(Time-to-Collision Estimation)是智能辅助驾驶系统中的核心任务之一。然而,现有的基于传统视觉的解决方案受到帧相机(frame-based camera)的采样原理的限制,无法胜任高速(相对)环境下的动态环境感知任务。周易教授团队提出了一种基于类神经形态视觉传感器(事件相机)的解决方案,具体的贡献包括:更精确的时变运动学模型、基于几何误差的稳健线性求解器,以及基于空间-时间配准的非线性优化算法。大量实验验证表明,周易教授团队提出方法实现了高效且准确的碰撞时间估计(最高达到200Hz),在效率和准确性方面均优于其他基于帧相机和事件相机的方法。

有关研究成果题为“Event-Aided Time-to-Collision Estimation for Autonomous Driving”的论文已被计算机视觉国际顶级会议ECCV 2024收录,第一作者为周易教授课题组2022级博士研究生李景行,共同第一作者为课题组2019级本科实习生廖邦彦(现西湖大学2023级博士生),通讯作者为周易教授。此外,文章的合作者还包括西湖大学刘沛东教授,香港科技大学郑家纯机器人研究所在读博士路修远(现NAIL访问学生)以及沈劭劼教授。

从视觉数据中恢复相机自运动和场景几何参数是计算机视觉领域的一个基本问题。该问题和其解决方案在传统视觉中的成功归功于特征提取、数据关联和多视图几何理论与方法的成熟。最近出现的基于类神经形态的事件相机对使用原始事件数据作为输入来解决这个基本问题产生了巨大的需求。然而,现有的解决方案通常通过迭代地逆转事件数据生成过程来隐式地推断事件的数据关联,这些方法的非线性性质限制了它们在实时任务中的适用性;此外,常用的恒定运动假设会导致结果不稳定。

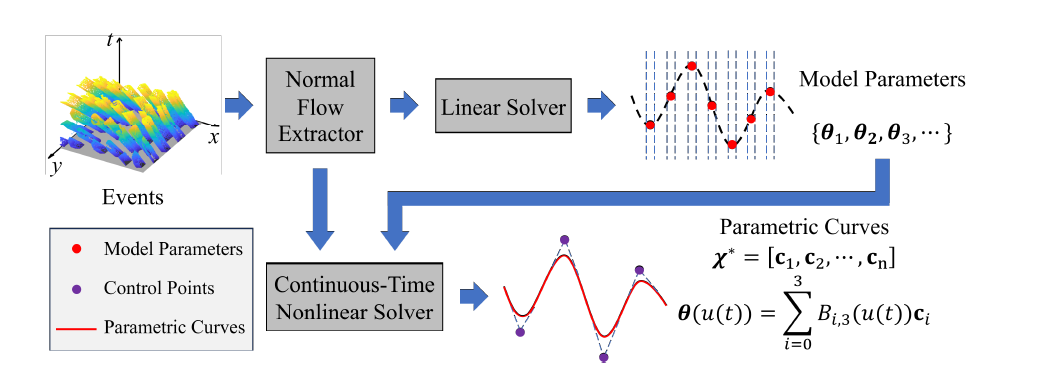

为此,周易教授团队从更加符合事件相机的差分工作原理出发重新该思考问题的构造方式。证明了通过所提出的几何误差项,可以使用基于事件的法向流作为光流的替代品来解决涉及瞬时一阶运动学和场景几何参数的几何问题,团队在提出的几何误差项的基础上开发了一个快速线性求解器和一个连续时间非线性求解器。实验证明了线性求解器在精度方面的优越性和效率,并指出其能够作为现有非线性求解器的初始化方法。此外,所提出的连续时间非线性求解器由于不依赖于恒定运动假设,在适应运动的突然变化方面表现出卓越的能力。

研究成果“Motion and Structure from Event-based Normal Flow”同样被ECCV 2024收录,第一作者为周易教授课题组2022级硕士研究生任重阳,廖邦彦为共同一作,周易教授为通讯作者。此外,文章的合作者还包括课题组2022级博士生孔德磊、李景行,以及西湖大学刘沛东教授,上海科技大学Laurent Kneip教授和柏林工业大学Guillermo Gallego教授。

来源:机器人学院

通讯员:江颖